La continuité de l'apprentissage à l'ère de l'IA

Comment échapper à l'atrophie cérébrale au moment où nous en avons le plus besoin

L'intelligence artificielle, en offrant une réponse instantanée à chaque question, court-circuite silencieusement les mécanismes cognitifs qui font de l'apprentissage non pas un résultat, mais un processus; l'effort, la frustration, la réactivation mémorielle, la lente construction de schémas mentaux durables. Ce que nous gagnons en fluidité, nous risquons de le perdre en profondeur : et c'est précisément au moment où la complexité du monde exige des esprits plus agiles, plus critiques et plus autonomes, que nous sommes tentés de déléguer notre intelligence à une machine.

L'IA, miroir sans tain de notre intelligence

En 2023, un étudiant en droit d'une grande université américaine rendit un mémoire de soixante pages entièrement rédigé par un modèle de langage génératif. Ses professeurs ne décelèrent rien d'inhabituel. Ni dans la structure, ni dans les arguments, ni dans le style. Tout était cohérent, documenté, convaincant. Ce qui manquait, en revanche, était invisible : aucune trace de l'effort intellectuel qui transforme une information en savoir, une donnée en compréhension, une réponse en jugement. L'étudiant avait obtenu une note. Il n'avait rien appris.

L'intelligence artificielle est un piège imparable : elle reflète l'ensemble du savoir humain accumulé, mais dissimule à celui qui la consulte l'image de sa propre pensée en train de s'effacer. D'un côté, elle représente l'une des plus spectaculaires amplifications de l'accès à la connaissance depuis l'invention de l'imprimerie, instantanée, personnalisée, disponible en toutes langues et à toute heure. De l'autre, elle court-circuite silencieusement les mécanismes cognitifs qui font de l'apprentissage non pas un résultat, mais un processus : l'effort, la frustration, la réactivation mémorielle, la construction progressive de schémas mentaux.

Cette tension n'est pas anecdotique. Elle définit l'un des défis éducatifs les plus profonds de notre époque. Pour le comprendre, il faut remonter à la longue histoire des révolutions cognitives, examiner ce que les neurosciences nous disent du cerveau apprenant, mesurer les risques propres à l'ère de l'oracle algorithmique, et enfin proposer des voies concrètes pour ne pas sacrifier l'intelligence humaine sur l'autel de la commodité numérique.

Cinq axes, interdépendants, composent cette cartographie des enjeux.

Une inquiétude aussi vieille que le progrès

L'histoire de l'éducation est jalonnée de révolutions technologiques, et chacune d'elles a déclenché les mêmes angoisses fondamentales. Socrate, rapporté par Platon dans le Phèdre, redoutait que l'écriture n'affaiblit la mémoire et n'instillât dans les esprits une apparence de savoir plutôt qu'un savoir véritable. Il n'avait pas tort sur le diagnostic, mais tort sur la conclusion : l'écriture n'a pas abêti l'humanité, elle a reconfiguré ses modalités d'apprentissage. La paideia grecque (idéal éducatif et culturel de la Grèce antique), fondée sur la dialectique et l'effort de la pensée, valorisait précisément ce que l'écriture menaçait de diluer : la confrontation vivante avec l'incertitude.

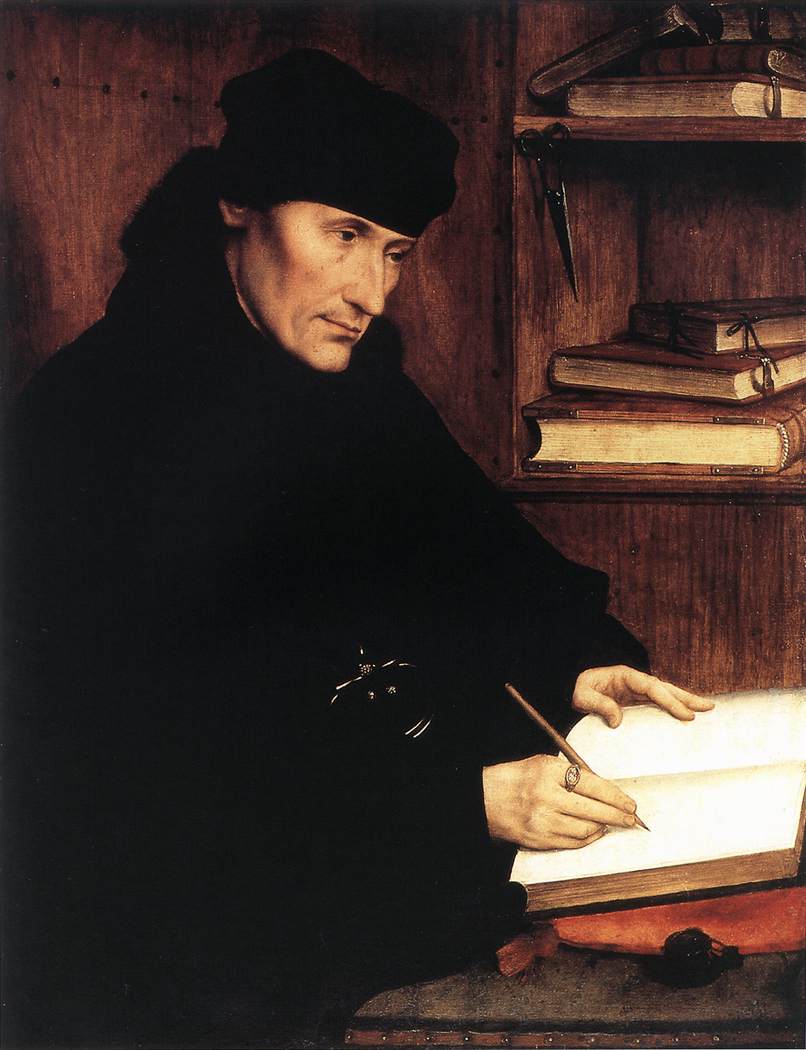

Au Moyen Âge, les moines copistes incarnaient une autre figure de l'apprentissage par l'effort. Reproduire un texte à la main n'était pas une tâche mécanique mais une pratique mémorielle totale, une immersion dans la structure même de la pensée d'autrui. Lorsque Gutenberg révolutionna la diffusion des idées, Érasme s'enthousiasma, mais d'autres perçurent dans la multiplication des livres une menace pour la formation de l'esprit critique : à quoi bon penser par soi-même si tout est déjà écrit ?

Érasme, par Quentin Metsys, 1517.

Les XVIIIe et XIXe siècles virent naître l'école républicaine, portée par Condorcet et son rêve d'égalité par le savoir. Mais Rousseau avait déjà mis en garde contre l'instruction purement transmissive, celle qui remplit les esprits sans les former. Dewey, au tournant du XXe siècle, théorisa ce que nous appellerions aujourd'hui l'apprentissage expérientiel : apprendre, c'est faire, tâtonner, recommencer. Puis vinrent la radio, la télévision, et avec eux McLuhan et Postman, qui alertèrent sur la superficialité d'une culture fondée sur la consommation passive d'images et de sons. Chaque époque a eu ses prophètes du déclin cognitif, et chaque époque a partiellement raison.

L'IA n'est pas une rupture absolue. Elle est le dernier acte d'une dialectique millénaire entre l'outil et l'intelligence qui l'utilise. Mais son intensité, sa vitesse et son ubiquité lui confèrent une dimension inédite. Elle ne se contente pas de diffuser le savoir : elle prétend le produire, le synthétiser, et désormais, l'incarner pédagogiquement. Comment ne pas y voire le point de fusion du medium avec non-seulement le message mais aussi son destinataire ? C'est là que l'enjeu change de nature.

L'effort contre la fluidité : ce que l'on perd en gagnant du temps

Pendant des millénaires, les méthodes d'apprentissage ont été lentes, coûteuses et souvent douloureuses. C'est précisément cette lenteur qui garantissait leur efficacité. La répétition espacée, codifiée par Hermann Ebbinghaus dès la fin du XIXe siècle, repose sur un principe simple : c'est le retour régulier sur une information, à intervalles croissants, qui ancre durablement un souvenir dans la mémoire à long terme. La méthode maïeutique de Socrate reposait sur la même logique : forcer l'élève à accoucher lui-même de la connaissance, en le plaçant face à ses propres contradictions. Ces processus sont coûteux cognitivement. Et c'est justement leur coût qui les rend efficaces.

Les nouvelles approches numériques ont optimisé l'accès, mais parfois au détriment de la profondeur. Les plateformes comme Khanmigo ou Duolingo Max offrent une personnalisation pédagogique remarquable, adaptant le rythme, le niveau et le format aux besoins de chaque apprenant. La gamification capte l'attention et suscite l'engagement, du moins initialement. Le micro-learning permet d'intégrer l'apprentissage dans les interstices du quotidien. Ces innovations sont réelles et précieuses.

Mais elles comportent un angle mort : elles favorisent la motivation extrinsèque (la récompense, le badge, le score) au détriment de la motivation intrinsèque, qui seule permet un apprentissage durable et autodirigé. Kahneman (que cite aujourd'hui volontiers Yann Le Cun pendant ses conférences), dans sa distinction entre Système 1 (pensée rapide, automatique) et Système 2 (pensée lente, délibérative), nous offre un cadre analytique précieux : les outils numériques conçus pour la fluidité activent quasi exclusivement le Système 1. Or, c'est le Système 2, laborieux, inconfortable, résistant,qui construit la compréhension profonde.

La synthèse n'est pas de rejeter les nouvelles méthodes, mais de reconnaître qu'elles exigent une gouvernance pédagogique consciente. L'IA optimise l'accès au savoir, mais elle ne remplace pas les mécanismes lents et coûteux qui forgent l'intelligence humaine : l'effort, la frustration, et le temps.

Ce que le cerveau perd quand une machine pense à sa place

Les neurosciences offrent aujourd'hui un éclairage saisissant sur les effets de l'externalisation cognitive. Le principe de plasticité cérébrale, formalisé par Donald Hebb, stipule que les connexions neuronales se renforcent par l'usage répété et s'affaiblissent dès lors qu'elles ne sont plus sollicitées. Le cerveau se reconfigure littéralement en fonction des tâches qu'on lui confie ou qu'on lui épargne. Lorsqu'une machine pense à notre place, ce ne sont pas seulement des secondes de réflexion que nous économisons : ce sont des circuits neuronaux que nous laissons s'atrophier.

Betsy Sparrow et ses collègues ont démontré en 2011 ce qu'ils ont appelé l'"effet Google" : lorsque nous savons qu'une information est accessible immédiatement en ligne, notre cerveau investit moins d'effort pour la mémoriser. L'hippocampe, siège de la mémoire à long terme, est moins sollicité. Le cortex préfrontal, qui gouverne le raisonnement abstrait et la prise de décision, est contourné. Nous stockons non plus la connaissance, mais l'adresse où la trouver. Stanislas Dehaene, dans ses travaux sur l'apprentissage, souligne que la lecture profonde, l'écriture manuelle et la résolution de problèmes complexes activent des réseaux neuronaux étendus et diffus, exactement ceux que l'usage délégué de l'IA tend à sous-utiliser.

La méta-cognition, cette capacité à penser sur sa propre pensée, théorisée par Flavell, constitue peut-être la victime la plus silencieuse de cette délégation. Un étudiant qui utilise un modèle de langage pour rédiger un essai n'active pas les mêmes réseaux neuronaux que celui qui lit, synthétise, hésite, reformule et écrit. Le premier stocke des réponses ; le second construit des schémas mentaux. Vygotski nous rappelle que le développement cognitif s'opère dans la zone proximale, cet espace inconfortable entre ce que l'on sait déjà faire et ce que l'on ne sait pas encore faire seul. Placer une IA dans cet espace, c'est supprimer précisément l'endroit où le cerveau grandit.

L'oracle algorithmique et l'illusion du savoir total

Au-delà des mécanismes individuels, l'IA génère un problème épistémologique d'une ampleur nouvelle : elle donne des réponses. Pas des questions. Or, le cœur de la formation intellectuelle, depuis Socrate jusqu'à Popper, réside précisément dans l'art de douter, de formuler des hypothèses, d'accepter l'incertitude comme condition de la pensée vivante.

Lorsqu'un futur médecin délègue à un système algorithmique l'identification d'un diagnostic différentiel, il acquiert peut-être une réponse correcte. Mais il ne développe pas le raisonnement clinique qui lui permettra de gérer les cas atypiques, les symptômes contradictoires, les patients qui ne correspondent pas aux modèles d'entraînement. Il ne développe pas non plus ce que Michael Polanyi appelait le savoir tacite, cette intelligence incorporée, non formalisable, qui s'acquiert par l'expérience répétée, l'échec, et la relation humaine. Un médecin formé à l'oracle algorithmique saura diagnostiquer, mais sera peu enclin à l'écoute et à l'anticipation.

Il y a un troisième risque, plus structurel : les grands modèles de langage reproduisent et amplifient les biais statistiques de leurs données d'entraînement. Harari, dans sa réflexion sur l'Homo Deus, anticipe une humanité qui délègue progressivement ses décisions à des systèmes opaques. Cathy O'Neil, de son côté, a documenté comment les algorithmes peuvent institutionnaliser les inégalités sous un vernis d'objectivité mathématique. L'IA ne nous apprend pas ce que nous n'avons pas déjà su lui enseigner et en standardisant les savoirs, elle risque d'appauvrir la diversité épistémique qui constitue la véritable richesse de la pensée humaine.

Réapprendre à apprendre à l'ère des machines

Face à ces risques, la tentation du rejet radical est compréhensible mais stérile. L'IA est là, et ses bénéfices sont réels. La question n'est pas de choisir entre elle et l'intelligence humaine, mais de définir les conditions d'une cohabitation émancipatrice.

Pour les étudiants, cela implique d'adopter ce que l'on pourrait appeler la règle des trois E : l'Effort comme posture par défaut, l'Erreur comme étape constitutive du savoir, l'Exploration comme refus des réponses préfabriquées. Concrètement, cela se traduit par le recours aux techniques de mémorisation active, cartographie mentale, principe Feynman d'enseignement mutuel, réactivation espacée et par une utilisation délibérément limitée de l'IA pour les tâches qui sollicitent la pensée critique.

Pour les enseignants, la priorité est pédagogique avant d'être technologique : apprendre à questionner l'IA plutôt qu'à lui obéir, construire des séquences hybrides où l'outil numérique gère l'accès à l'information tandis que l'humain assume la synthèse, le débat, le jugement. La relation maître-élève, dans sa dimension affective et improvisatrice, reste irremplaçable. C'est dans cette relation que s'opère la transmission des savoirs tacites.

Pour les institutions, la réforme des modes d'évaluation est urgente. Moins de restitution mémorisée, davantage de projets transversaux, de mises en situation ouvertes, de problèmes sans solution unique. Former aux limites de l'IA, ses biais, ses hallucinations, son incapacité à générer de véritables questions, doit devenir une compétence fondamentale au même titre que la lecture ou le calcul. Nous en sommes encore très loin, bien que des signes de bonne volonté semblent poindre.

Une intelligence à défendre

L'IA est un accélérateur de savoirs, mais sans effort, elle devient un frein à l'intelligence. Ce paradoxe n'est pas une fatalité : il est un défi de gouvernance cognitive, pédagogique et institutionnelle.

Dans le scénario optimiste, l'IA devient ce que les meilleures technologies ont toujours été : un amplificateur des capacités humaines, libérant l'esprit des tâches mécaniques pour lui permettre de s'élever vers la création, la nuance et l'empathie. Dans le scénario pessimiste, elle devient le substitut de la pensée pour des générations d'apprenants qui n'auront jamais développé les muscles cognitifs nécessaires pour en contester les réponses.

Le choix entre ces deux scénarios n'est pas technologique. Il est profondément humain. Il dépend de la volonté collective de maintenir l'effort au cœur de l'éducation, de valoriser la lenteur délibérative dans une culture de l'instantané, et de résister à l'illusion que la commodité est synonyme de progrès.

Le défi ultime est celui-ci : comment faire de l'IA un outil d'émancipation, et non de dépendance ? La réponse n'est ni dans les algorithmes, ni dans les politiques publiques seules, elle est dans nos cerveaux, et dans la décision consciente de continuer à les exercer.

Annexe — Sources et références

Neurosciences et cognition

- Dehaene, S. (2018). Apprendre ! Les talents du cerveau, le défi des machines. Odile Jacob.

- Kahneman, D. (2011). Thinking, Fast and Slow. Farrar, Straus and Giroux.

- Sparrow, B., Liu, J., & Wegner, D. M. (2011). Google Effects on Memory: Cognitive

- Consequences of Having Information at Our Fingertips. Science, 333(6043), 776–778. https://doi.org/10.1126/science.1207745

- Hebb, D. O. (1949). The Organization of Behavior. Wiley.

- Ebbinghaus, H. (1885). Über das Gedächtnis. Duncker & Humblot.

Sciences de l'éducation

- Vygotski, L. S. (1934/1985). Pensée et Langage. Éditions Sociales.

- Dewey, J. (1897/1990). The School and Society. University of Chicago Press. Flavell, J. H. (1979). Metacognition and Cognitive Monitoring. American Psychologist, 34(10), 906–911.

- Piaget, J. (1970). L'Épistémologie génétique. Presses Universitaires de France.

IA, société et épistémologie

- O'Neil, C. (2016). Weapons of Math Destruction. Crown Publishers.

- Polanyi, M. (1966). The Tacit Dimension. Doubleday.

- Postman, N. (1985). Amusing Ourselves to Death. Viking Penguin.

- McLuhan, M. (1964). Understanding Media: The Extensions of Man. McGraw-Hill.

Références historiques et philosophiques

- Platon. Phèdre (trad. L. Robin). Gallimard, coll. Pléiade.

- Condorcet, N. de (1791/1994). Cinq mémoires sur l'instruction publique. Flammarion.

- Érasme, D. (1511). Éloge de la folie. (éd. de référence : Flammarion, 2011).