Pendant trois décennies, l'architecture de référence de Purdue, formalisée sous l'appellation ISA-95 et gravée dans le marbre des cahiers des charges industriels du monde entier, a constitué la colonne vertébrale invisible de l'industrie manufacturière globale. Elle a structuré la séparation des responsabilités, organisé les flux de données, défini les périmètres de sécurité, et donné aux DSI industriels un langage commun pour concevoir leurs systèmes d'information. Elle a été, pendant longtemps, une réponse élégante à un problème réel.

Ce temps est révolu.

Non pas parce que le modèle était mauvais, il était, dans son contexte, remarquablement bien conçu. Mais parce que les fondements sur lesquels il reposait, la latence tolérable, les données ascendantes, la décision humaine, la séparation nette entre le monde opérationnel et le monde informationnel, sont précisément ceux que l'intelligence artificielle est en train de pulvériser, couche par couche, avec une méthode que personne n'avait anticipée à cette vitesse ni à cette échelle.

Ce que Purdue a résolu, et pourquoi cette solution est devenue un problème

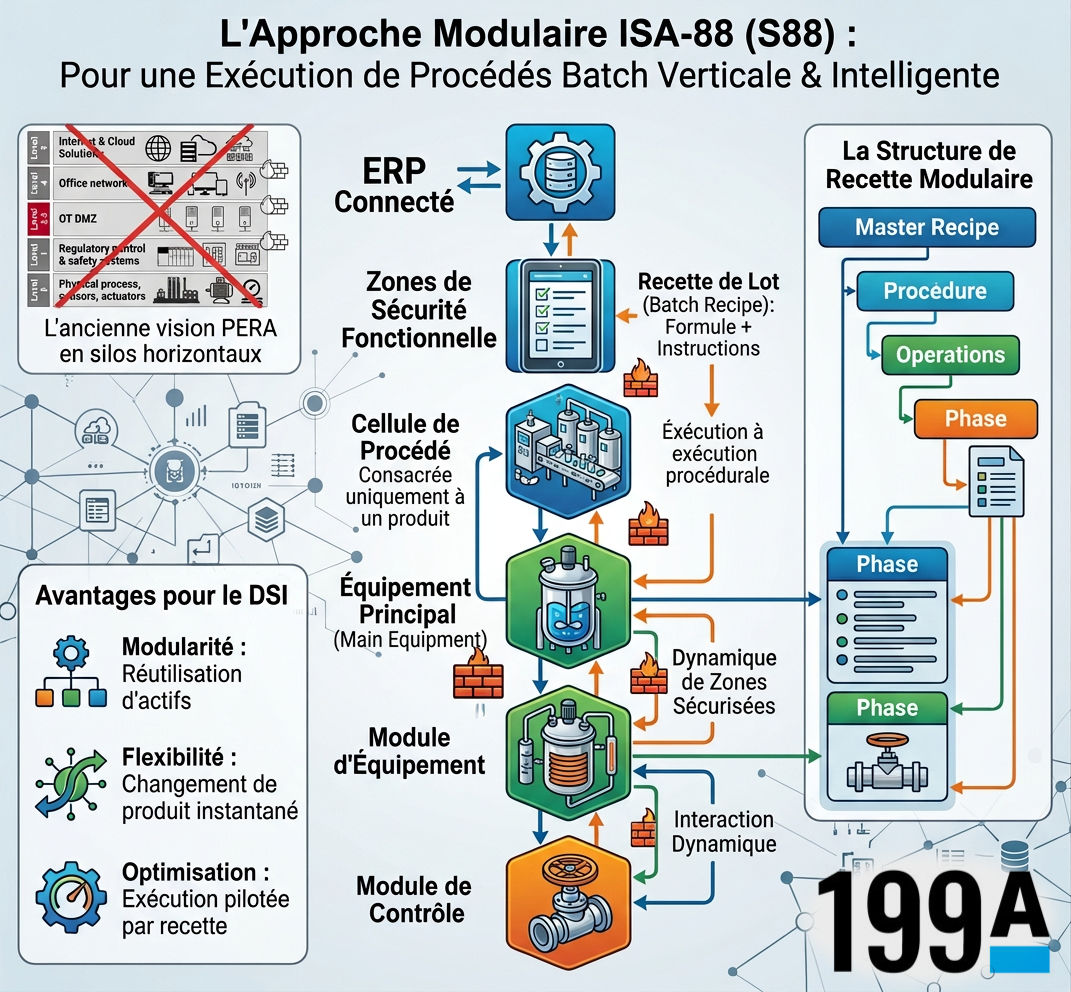

Theodore Williams, lorsqu'il a posé les bases du modèle PERA à l'Université de Purdue dans les années 1990, répondait à une problématique concrète : comment intégrer des systèmes industriels hétérogènes dans une architecture cohérente, sécurisée et gouvernable ? La réponse, une pyramide à cinq niveaux allant du capteur physique jusqu'au système d'information d'entreprise, était d'une clarté presque pédagogique. Le niveau zéro abrite les capteurs et actionneurs. Le niveau un, les automates programmables. Le niveau deux, les systèmes SCADA et de supervision. Le niveau trois, les MES qui orchestrent l'exécution de la production. Le niveau quatre, enfin, les ERP et systèmes de planification qui parlent le langage du business.

La beauté de ce modèle résidait dans sa logique de ségrégation. Chaque couche communique avec ses voisines immédiates, rarement au-delà. L'information remonte lentement, s'enrichit à chaque niveau, et arrive au management sous une forme agrégée, normalisée, prête à l'analyse décisionnelle. L'air gap entre les couches OT et les couches IT n'était pas un défaut d'architecture mais une fonctionnalité de sécurité délibérée. Un automate pilotant un four à 1 400 °C n'a, dans cette logique, aucune raison d'être exposé au réseau informatique de l'entreprise.

Cette logique était parfaitement adaptée à un monde où la donnée était rare, lente, et chère à traiter. Elle est catastrophiquement inadaptée à un monde où la donnée est abondante, instantanée, et où la capacité d'inférence peut désormais résider dans un composant de la taille d'une carte de crédit installé directement sur la ligne de production.

L'IA comme solvant architectural

Ce qui change fondamentalement avec l'IA industrielle de 2026 n'est pas tant la puissance de calcul disponible, bien que celle-ci soit stupéfiante, que la localisation de l'intelligence. Pendant des décennies, l'analyse vivait au sommet de la pyramide, dans les datacenters, dans les outils de Business Intelligence, dans les cerveaux des analystes qui travaillaient à distance temporelle et spatiale de la production. L'actuation, l'action sur le process, vivait en bas de la pyramide : rapide et bête.

L'IA inverse cette topographie. Les modèles d'inférence embarqués, que l'on déploie aujourd'hui directement sur des PLCs nouvelle génération, sur des passerelles edge ou dans des jumeaux numériques temps réel, sont capables d'analyser, de décider et d'actionner sans jamais faire remonter la donnée jusqu'aux niveaux supérieurs. Un modèle de détection d'anomalie vibratoire déployé en edge sur un compresseur industriel ne consulte pas le MES avant de déclencher un ralentissement préventif. Il agit, en quelques millisecondes, sur la base de patterns appris pendant des mois d'entraînement. La donnée n'est plus ascendante. Elle est locale, traitée, actionnée et souvent consumée sur place.

Cette réalité crée ce que l'on pourrait appeler un court-circuit architectural. Dans le modèle PERA, une décision d'ajustement de process était le fruit d'une boucle longue : capteur, automate, SCADA, MES, analyse humaine, consigne redescendante. Cette boucle pouvait prendre des heures, parfois des jours. Un système d'IA embarqué court-circuite l'intégralité de cette chaîne. Ce n'est pas une optimisation du modèle existant. C'est sa négation fonctionnelle.

Chez un grand équipementier automobile européen, l'implémentation d'un système de vision artificielle couplé à un modèle de contrôle qualité prédictif a rendu structurellement inutile deux niveaux entiers de la pyramide Purdue pour le périmètre concerné. Le capteur voit, le modèle juge, l'actionneur réagit. Le MES apprend le résultat après coup, pour les besoins de traçabilité réglementaire. La pyramide n'a pas disparu, mais elle a changé de nature : d'architecture décisionnelle, elle est devenue architecture de conformité.

La désintégration silencieuse de la couche de responsabilité

Là où l'impact du modèle PERA était le plus profond, et là où son effacement est le plus dangereux, c'est dans sa dimension organisationnelle. La pyramide n'était pas qu'un schéma technique. C'était un organigramme implicite. Chaque couche avait ses responsables, ses compétences, ses outils, ses métriques. L'opérateur de conduite de procédé était souverain sur les niveaux 1 et 2. Le responsable de production régnait sur le niveau 3. Le DSI et ses équipes gouvernaient les niveaux 4 et 5. La frontière OT/IT était aussi une frontière de métier, de culture, parfois de convention collective.

L'IA dissout cette géographie des responsabilités avec une brutalité que peu d'organisations industrielles ont eu le temps d'anticiper. Qui est responsable d'une décision prise de manière autonome par un modèle déployé en edge ? L'ingénieur OT qui a intégré le capteur ? Le data scientist qui a entraîné le modèle ? Le DSI qui a validé l'architecture de déploiement ? Le responsable de production qui a signé le bon de commande de la solution ? Dans le modèle PERA, cette question ne se posait pas, ou rarement, parce que la décision était toujours, in fine, humaine. Un humain voyait l'alerte, un humain prenait la décision, un humain en assumait la responsabilité.

Dans l'architecture émergente, la décision peut s'être produite et avoir été actionnée avant qu'un seul humain ait eu connaissance de la situation. Ce n'est pas de la science-fiction. C'est ce qui se passe aujourd'hui dans les process continus, dans la chimie, dans l'énergie, dans la sidérurgie. Et c'est ce qui va s'intensifier de manière exponentielle dans les dix-huit prochains mois avec la généralisation des agents autonomes industriels, ces systèmes capables non seulement d'analyser et d'agir, mais de planifier des séquences d'actions sur des horizons de temps plus longs.

Pour un DSI industriel, ignorer cette question est une faute professionnelle. La construire techniquement sans la traiter organisationnellement et juridiquement est une faute stratégique.

L'Unified Namespace comme métaphore d'un nouveau paradigme

Face à l'éclatement de la pyramide, une architecture alternative s'est imposée dans les conversations des architectes systèmes les plus avancés : l'Unified Namespace, ou UNS. Le concept, popularisé notamment par Walker Reynolds et largement adopté dans les industries de process les plus matures dans l'intégration de solution numériques avancées, rompt radicalement avec la logique ascendante de PERA. Plutôt qu'une structure hiérarchique où la donnée remonte de couche en couche, l'UNS propose un espace de données centralisé et contextuel auquel tous les systèmes, capteurs, automates, MES, ERP, modèles IA, interfaces opérateurs, se connectent directement, en publication ou en souscription.

Ce modèle, souvent implémenté via des brokers MQTT ou des plateformes d'orchestration de données industrielles, présente une vertu architecturale fondamentale : il fait disparaître la notion de couche au profit de la notion de contexte. La donnée n'appartient plus à un niveau hiérarchique. Elle appartient à un actif physique, enrichie de son contexte opérationnel, accessible à tout consommateur autorisé, qu'il soit humain ou algorithmique.

Pour le DSI, l'UNS n'est pas une solution clé en main. C'est une philosophie de conception qui implique de repenser intégralement la gouvernance de la donnée industrielle, la sécurité des accès OT/IT (qui ne peuvent plus être séparés par un air gap physique quand tous les acteurs consomment la même source), et la modélisation des actifs dans des ontologies standardisées, que les frameworks comme ISA-88 pour les équipements batch ou les modèles Asset Administration Shell de l'Industrie 4.0 commencent à formaliser.

Le DSI industriel en 2026

La réponse à l'obsolescence de PERA n'est pas de le détruire sans réfléchir. Dans de nombreux environnements industriels, industries à risques, environnements soumis à des régulations strictes comme le nucléaire, la pharmacie ou l'agroalimentaire certifié, la ségrégation des réseaux et la traçabilité ascendante restent des exigences réglementaires non négociables. Purdue, dans ces contextes, survit, non comme paradigme architectural global, mais comme garant d'une conformité minimale.

Ce que le DSI doit construire, c'est une architecture hybride et stratifiée, capable de coexister avec les contraintes réglementaires héritées tout en intégrant les nouveaux paradigmes d'actuation IA. Concrètement, cela signifie accepter que différentes parties de l'architecture industrielle évoluent à des vitesses différentes, avec des périmètres clairement définis où l'autonomie décisionnelle de l'IA est autorisée, documentée et auditée.

Cela signifie également investir massivement dans ce qui est devenu le vrai différenciateur compétitif des prochaines années : non pas les capteurs, non pas les modèles IA eux-mêmes, mais la qualité et la gouvernance de la donnée industrielle brute. Les modèles IA les plus sophistiqués du monde sont inutilisables si les données sur lesquelles ils s'appuient sont sales, mal contextualisées, sans historique fiable. L'industrie manufacturière souffre massivement de ce problème, et c'est précisément là que le DSI a son rôle le plus critique à jouer, non comme acheteur de solutions IA, mais comme gardien de l'intégrité informationnelle de l'entreprise.

Enfin, et c'est peut-être le chantier le plus sous-estimé, le DSI industriel de 2026 doit piloter la refonte des rôles humains dans la chaîne décisionnelle. L'analyste de production qui passait ses journées à interpréter des tableaux de bord SCADA n'a plus la même valeur qu'il y a cinq ans. Sa valeur résiduelle, et elle est réelle, est dans sa capacité à superviser, challenger et corriger des systèmes autonomes, à maintenir l'expertise contextuelle que l'IA ne peut pas encore construire seule, à être l'interface entre la rationalité algorithmique et la complexité humaine de l'organisation. Former ces personnes, redéfinir leurs fiches de poste, construire les outils de supervision des systèmes IA : c'est là que se joue la réussite ou l'échec des projets d'IA industrielle les plus ambitieux.

La dimension assurantielle : le verrou que personne ne voit venir

Il existe une dimension du déploiement de l'IA industrielle que les DSI n'ont, à ce stade, presque jamais inscrite à leur agenda. Elle n'est pas technique. Elle n'est pas organisationnelle. Elle est économique et juridique, et elle constitue, selon toute vraisemblance, le principal facteur limitant de la prochaine décennie.

Le livre blanc « Delegated Decision Assurance » publié en février 2026 par le cabinet 199A Consulting pose ce diagnostic avec une précision qui mérite d'être prise au sérieux par tout décideur industriel : « Le facteur limitant de la révolution autonome n'est pas technique. Il est économique et juridique. Il réside dans l'absence d'une infrastructure capable d'absorber, de distribuer et de tarifer la responsabilité des décisions prises par des agents non humains. »

Le mécanisme est simple, et il s'applique directement à l'industrie. Lorsqu'un agent IA embarqué prend une décision de maintenance autonome qui conduit à un arrêt non planifié d'une ligne de production, ou pire, à un incident de sécurité, la chaîne de responsabilité juridique éclate en fragments impossibles à recoller. Le document identifie ce qu'il nomme une « triple fracture » : le fait générateur devient diffus (qui, du concepteur du modèle de base, de l'intégrateur, de l'exploitant, est responsable ?), le lien de causalité devient opaque (un réseau neuronal profond ne produit pas de raisonnement linéaire traçable), et l'imputation devient problématique (chaque acteur de la chaîne dispose d'arguments solides pour se défausser). Cette triple fracture n'est pas une difficulté marginale, elle constitue, selon les auteurs, « un blocage structurel qui empêche l'économie de franchir le seuil de l'automatisation totale et authentique ».

Les conséquences pratiques pour un DSI industriel sont immédiates. Les compagnies d'assurance industrielle commencent à poser des questions précises sur les périmètres de décision des systèmes IA déployés en production. Les contrats de fourniture intègrent des clauses de plus en plus complexes sur la responsabilité des décisions automatisées. Les conseils d'administration, personnellement exposés en cas de dommage causé par un agent autonome, exercent une pression croissante pour le maintien d'une supervision humaine qui, justement, annule une grande partie du bénéfice de l'automatisation. Le rapport 199A nomme cette dynamique avec justesse : « La prudence fiduciaire conduit naturellement à freiner, voire à bloquer, le déploiement. »

La réponse à ce blocage, que le document appelle une infrastructure de « Delegated Decision Assurance », est un ensemble de mécanismes techniques, contractuels, actuariels et réglementaires par lesquels une entité identifiée accepte de se porter garante des décisions prises par un agent autonome, en échange d'une rémunération proportionnée au risque assumé. Elle n'est pas encore mature. Mais sa nécessité est désormais incontournable, et les premières formes en émergent déjà dans les secteurs financier et énergétique. Pour le DSI industriel, intégrer cette dimension dès la conception des architectures IA, en construisant les couches d'encapsulation décisionnelle, de monitoring comportemental et d'audit explicable que cette infrastructure requiert, c'est ne pas se retrouver demain face à une impasse réglementaire ou assurantielle après avoir investi plusieurs millions dans des déploiements que personne ne pourra légalement couvrir. La technologie, comme le rappelle 199A avec une formule saisissante, est à l'image du moteur à combustion inventé cinquante ans avant le code de la route : « La technologie serait restée dans les garages, non par défaut de performance, mais par défaut de cadre. »

En guise de prospective : l'architecture comme acte politique

Dans dix-huit mois, les premiers agents IA industriels véritablement autonomes, capables de gérer des campagnes de production entières avec une supervision humaine intermittente, seront en production dans les entreprises les plus avancées. Dans cinq ans, ils seront la norme dans les industries de process. La question qui se pose alors n'est plus technique. Elle est profondément politique, au sens étymologique du terme : comment voulons-nous organiser le pouvoir dans l'entreprise industrielle de demain ? Quelle part de la décision sommes-nous prêts à déléguer à des systèmes que nous ne comprenons pas entièrement ? Comment construisons-nous la confiance, réglementaire, sociale, opérationnelle, dans des architectures où la machine décide ?

Le DSI industriel qui ne se pose pas ces questions aujourd'hui en construisant son socle SI les subira demain sous forme de crises : un incident mal attribué, une responsabilité juridique flottante, une résistance sociale interne qui bloquera le déploiement de solutions pourtant techniquement matures.

L'architecture de Purdue était, au fond, une réponse technique à une question politique : qui contrôle le process ? Elle avait le mérite de la clarté. La prochaine architecture industrielle devra répondre à la même question, dans un monde infiniment plus complexe, avec des outils infiniment plus puissants, et une capacité de nuire infiniment plus grande si la réponse est mal formulée.

Ce n'est pas un problème d'ingénierie. C'est un problème de civilisation industrielle. Et le DSI, qu'il le veuille ou non, en est l'un des principaux architectes.

Sources citées : 199A Consulting, « Delegated Decision Assurance. L'infrastructure économique qui rend possible le monde de l'IA opérationnelle », première édition, février 2026, V1.1 (https://199a.agency). L'auteur accompagne des groupes industriels de taille intermédiaire et des ETI dans la conception de leurs architectures SI/OT convergentes et la gouvernance de leurs programmes IA industriels.